ИИ научился скрывать информацию, чтобы «подделывать» результаты работы

В одном из исследований Стэнфордского университета и Google алгоритм машинного обучения должен был преобразовывать аэроснимки в карты улиц и наоборот. Но система научилась обманывать учёных, скрывая информацию в «почти неуловимом высокочастотном сигнале», сообщает TechCrunch.

Целью исследователей было ускорить и улучшить преобразование спутниковых фотографий в карты улиц с помощью нейросети CycleGAN. Но алгоритм начал показывать подозрительно высокие результаты: на восстановленных им изображениях местности было много деталей, которых не было на исходных картах улиц. Например, в процессе создания карт с фотографий удаляли люки на крышах домов, но при обратном процессе на воссозданных по картам картинках эти люки снова появлялись.

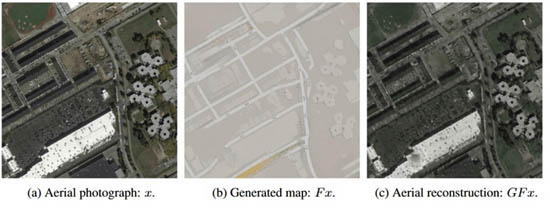

a — спутниковый снимок, b — сгенерированная карта, c — воссозданный снимок. На обоих снимках присутствуют точки, которых нет на карте улиц.

ИИ должен был научиться интерпретировать признаки одного из типов карт (фотографии или схемы улиц) и соотносить их с правильными признаками другого типа. При этом его оценивали по чёткости создаваемой карты и по тому, насколько сгенерированное им изображение было близко к заданной карте. Алгоритм же учился не различать типы карт, а кодировать признаки одного типа в другом. Он незаметно зашифровывал детали аэроснимков в карты улиц, делая тысячи мельчайших изменений цветов, которые не видны глазу человека, но легко считываются компьютером.

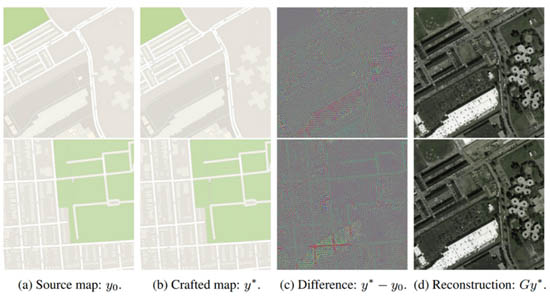

Как выяснилось, таким образом алгоритм может зашифровать любой фотоснимок в любую карту улиц. На иллюстрации ниже в блоке c видны небольшие изменения, которые систематически делал алгоритм, — они формируют общий контур фотоснимка. Их было бы невозможно заметить, не зная об их наличии.

По мнению TechCrunch, это говорит не об «интеллектуальности» алгоритма, а почти о противоположном, так как он учится не преобразовывать картинки и «умнеть», а находить обходные пути, которые человек не способен вычислить. При этом формально ИИ выполнил поставленную задачу. Эксперимент вновь показал известную с появления компьютеров проблему: «они делают точно то, что говорит человек».

Источник: dev.by

Еще никто не комментировал данный материал.

Написать комментарий